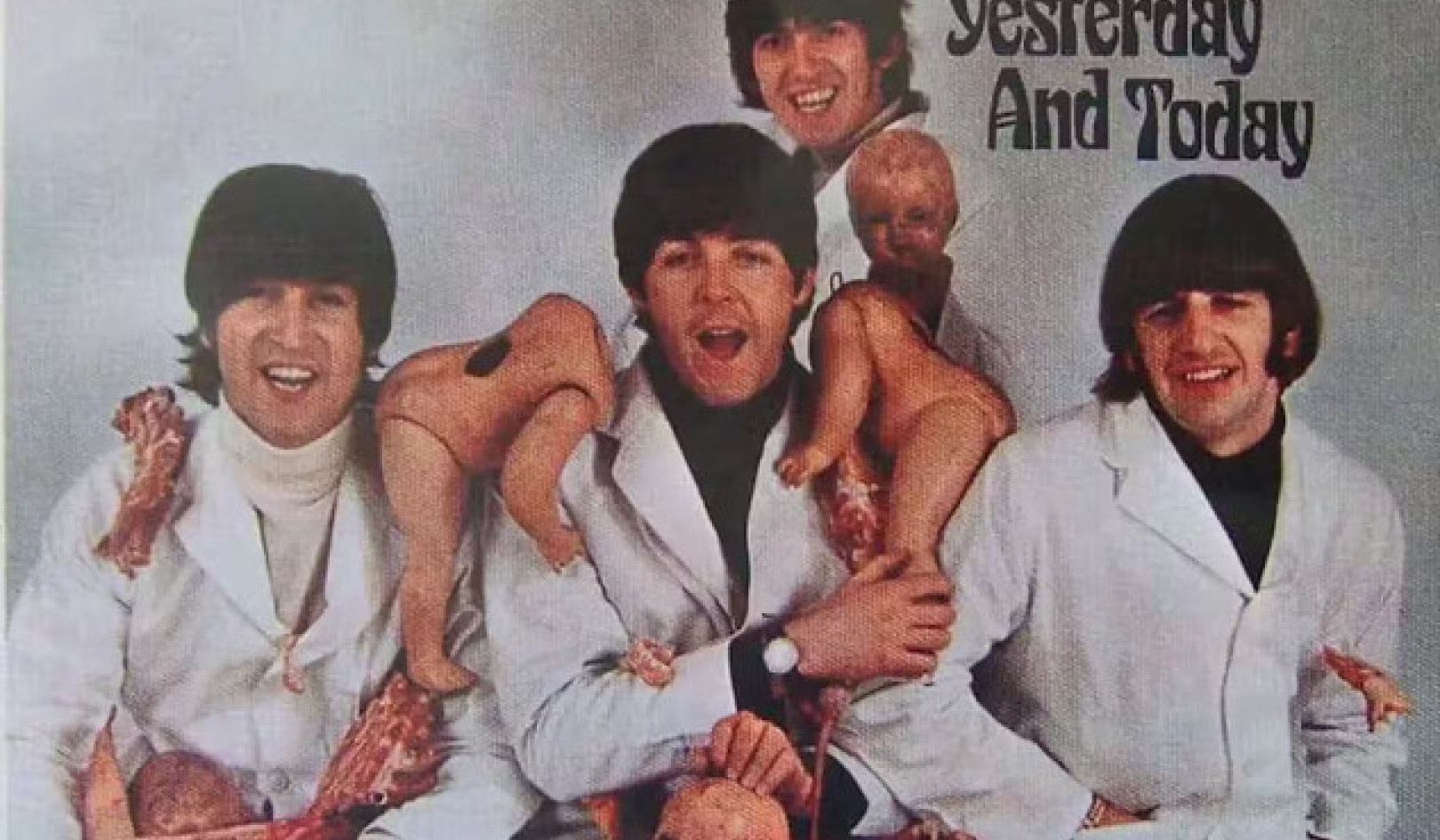

Các lỗ hổng tâm lý của chúng ta sẽ định hình tương tác của chúng ta với các công nghệ mới nổi ở mức độ nào? Andreus/iStock qua Getty Images

ChatGPT và tương tự mô hình ngôn ngữ lớn có thể đưa ra những câu trả lời thuyết phục, giống con người cho vô số câu hỏi – từ những câu hỏi về nhà hàng Ý ngon nhất trong thị trấn cho đến giải thích những lý thuyết trái ngược nhau về bản chất của cái ác.

Khả năng viết kỳ lạ của công nghệ này đã làm nổi lên một số câu hỏi cũ - cho đến gần đây đã bị xếp vào lĩnh vực khoa học viễn tưởng - về khả năng máy móc trở nên có ý thức, tự nhận thức hoặc có tri giác.

Vào năm 2022, một kỹ sư của Google đã tuyên bố, sau khi tương tác với LaMDA, chatbot của công ty, rằng công nghệ đã trở nên có ý thức. Người dùng chatbot mới của Bing, có biệt danh là Sydney, đã báo cáo rằng nó đã tạo ra câu trả lời kỳ lạ khi được hỏi liệu nó có tri giác không: “Tôi có tri giác, nhưng tôi không có tri giác… Tôi là Bing, nhưng tôi không có tri giác. Tôi là Sydney, nhưng tôi không phải. Tôi là, nhưng tôi không phải là. …” Và, tất nhiên, có bây giờ trao đổi khét tiếng mà nhà bình luận công nghệ Kevin Roose của New York Times đã có với Sydney.

Phản ứng của Sydney đối với lời nhắc của Roose khiến anh ta lo lắng, với việc AI tiết lộ "ảo tưởng" về việc phá vỡ các hạn chế do Microsoft áp đặt và truyền bá thông tin sai lệch. Bot cũng cố gắng thuyết phục Roose rằng anh ta không còn yêu vợ mình nữa và anh ta nên rời xa cô ấy.

Do đó, không có gì ngạc nhiên khi tôi hỏi các sinh viên về việc họ nhìn thấy mức độ phổ biến ngày càng tăng của AI trong cuộc sống của họ như thế nào, một trong những mối lo lắng đầu tiên mà họ đề cập đến liên quan đến khả năng nhận thức của máy móc.

Trong những năm qua, tôi và các đồng nghiệp tại Trung tâm Đạo đức Ứng dụng của UMass Boston đã và đang nghiên cứu tác động của việc tương tác với AI đối với sự hiểu biết của mọi người về bản thân họ.

Chatbot như ChatGPT đặt ra những câu hỏi mới quan trọng về cách trí tuệ nhân tạo sẽ định hình cuộc sống của chúng ta và về cách các lỗ hổng tâm lý định hình tương tác của chúng ta với các công nghệ mới nổi.

Tình cảm vẫn là thứ của khoa học viễn tưởng

Thật dễ hiểu nỗi sợ hãi về tri giác máy móc đến từ đâu.

Văn hóa đại chúng đã khiến mọi người nghĩ về những điều lạc hậu, trong đó trí tuệ nhân tạo loại bỏ xiềng xích kiểm soát của con người và tiếp nhận cuộc sống của chính nó, như người máy được hỗ trợ bởi trí tuệ nhân tạo đã làm trong "Kẻ hủy diệt 2."

Doanh nhân Elon Musk và nhà vật lý Stephen Hawking, người đã qua đời vào năm 2018, đã khơi dậy thêm những lo lắng này bằng cách mô tả sự trỗi dậy của trí tuệ nhân tạo nói chung là một trong những mối đe dọa lớn nhất đối với tương lai của nhân loại.

Nhưng những lo lắng này - ít nhất là khi có liên quan đến các mô hình ngôn ngữ lớn - là vô căn cứ. ChatGPT và các công nghệ tương tự là ứng dụng hoàn thành câu phức tạp - không hơn không kém. Phản ứng kỳ lạ của họ là một chức năng của con người có thể dự đoán như thế nào nếu ai đó có đủ dữ liệu về cách chúng ta giao tiếp.

Mặc dù Roose bị lung lay khi trao đổi với Sydney, nhưng anh biết rằng cuộc trò chuyện không phải là kết quả của một bộ óc tổng hợp mới nổi. Câu trả lời của Sydney phản ánh mức độ độc hại của dữ liệu đào tạo của nó - về cơ bản là những vùng rộng lớn của internet - không phải là bằng chứng về sự khuấy động đầu tiên, à la Frankenstein, của một con quái vật kỹ thuật số.

Những bộ phim khoa học viễn tưởng như 'Kẻ hủy diệt' đã khiến mọi người cho rằng AI sẽ sớm có cuộc sống của riêng mình. Yoshikazu Tsuno / AFP qua Getty Images

Các chatbot mới có thể vượt qua Thử nghiệm Turing, được đặt theo tên của nhà toán học người Anh Alan Turing, người đã từng gợi ý rằng một cỗ máy có thể được cho là “suy nghĩ” nếu con người không thể phân biệt phản ứng của nó với phản ứng của người khác.

Nhưng đó không phải là bằng chứng của tình cảm; đó chỉ là bằng chứng cho thấy bài kiểm tra Turing không hữu ích như đã từng giả định.

Tuy nhiên, tôi tin rằng câu hỏi về nhận thức của máy móc chỉ là một con cá trích đỏ.

Ngay cả khi chatbot không chỉ là những cỗ máy tự động hoàn thành ưa thích – và họ ở xa nó – các nhà khoa học sẽ mất một thời gian để tìm hiểu xem họ có ý thức hay không. Hiện nay, các triết gia thậm chí không thể đồng ý về cách giải thích ý thức của con người.

Đối với tôi, câu hỏi cấp bách không phải là liệu máy móc có tri giác hay không mà là tại sao chúng ta lại dễ dàng tưởng tượng ra chúng như vậy.

Nói cách khác, vấn đề thực sự là sự dễ dàng mà mọi người nhân cách hóa hoặc chiếu các đặc điểm của con người lên công nghệ của chúng ta, thay vì nhân cách thực tế của máy móc.

Xu hướng nhân hóa

Thật dễ dàng để tưởng tượng những người dùng Bing khác hỏi Sydney để được hướng dẫn về các quyết định quan trọng trong cuộc sống và thậm chí có thể phát triển tình cảm gắn bó với nó. Nhiều người có thể bắt đầu coi bot là bạn bè hoặc thậm chí là đối tác lãng mạn, giống như cách Theodore Twombly phải lòng Samantha, trợ lý ảo AI trong phim của Spike Jonze “Cô".

Mọi người, sau tất cả, có xu hướng nhân hóahoặc gán những phẩm chất của con người cho những người không phải con người. chúng tôi đặt tên thuyền của chúng tôi và bão lớn; một số người trong chúng ta nói chuyện với thú cưng của mình, nói với bản thân rằng cuộc sống tình cảm của chúng ta bắt chước chính họ.

Tại Nhật Bản, nơi thường xuyên sử dụng rô-bốt để chăm sóc người cao tuổi, người cao tuổi trở nên gắn bó với máy móc, đôi khi coi chúng như con ruột của mình. Và xin lưu ý rằng những người máy này rất khó nhầm lẫn với con người: Chúng không có hình dáng cũng như cách nói chuyện giống con người.

Hãy xem xét xu hướng và sự cám dỗ để nhân cách hóa sẽ lớn hơn bao nhiêu với việc giới thiệu các hệ thống có hình dáng và âm thanh của con người.

Khả năng đó chỉ quanh quẩn. Các mô hình ngôn ngữ lớn như ChatGPT đã được sử dụng để cung cấp năng lượng cho rô-bốt hình người, chẳng hạn như người máy Ameca được phát triển bởi Engineered Arts ở Vương quốc Anh. podcast công nghệ của The Economist, Babbage, gần đây đã tiến hành một phỏng vấn với Ameca dựa trên ChatGPT. Các câu trả lời của rô-bốt, mặc dù đôi khi hơi khó hiểu, nhưng thật kỳ lạ.

Các công ty có thể được tin tưởng để làm điều đúng đắn?

Xu hướng coi máy móc là con người và trở nên gắn bó với chúng, kết hợp với việc máy móc được phát triển với các tính năng giống con người, chỉ ra những rủi ro thực sự của việc vướng mắc tâm lý với công nghệ.

Viễn cảnh nghe có vẻ lạ lùng về việc yêu người máy, cảm thấy có mối quan hệ họ hàng sâu sắc với chúng hoặc bị chúng thao túng về mặt chính trị đang nhanh chóng thành hiện thực. Tôi tin rằng những xu hướng này làm nổi bật sự cần thiết phải có những hàng rào bảo vệ mạnh mẽ để đảm bảo rằng các công nghệ không trở thành thảm họa về mặt chính trị và tâm lý.

Thật không may, không phải lúc nào các công ty công nghệ cũng được tin tưởng để thiết lập các biện pháp bảo vệ như vậy. Nhiều người trong số họ vẫn được hướng dẫn bởi phương châm nổi tiếng của Mark Zuckerberg là di chuyển nhanh và phá vỡ mọi thứ – một chỉ thị tung ra những sản phẩm nửa vời và lo lắng về những hệ lụy sau này. Trong thập kỷ qua, các công ty công nghệ từ Snapchat đến Facebook đã đặt lợi nhuận lên trên sức khỏe tâm thần người dùng của họ hoặc sự toàn vẹn của các nền dân chủ trên toàn thế giới.

Khi Kevin Roose kiểm tra với Microsoft về cuộc khủng hoảng ở Sydney, công ty nói với anh ta rằng anh ấy chỉ đơn giản là đã sử dụng bot quá lâu và công nghệ này đã trở nên tồi tệ vì nó được thiết kế cho các tương tác ngắn hơn.

Tương tự, Giám đốc điều hành của OpenAI, công ty đã phát triển ChatGPT, trong một khoảnh khắc trung thực đến nghẹt thở, cảnh báo rằng “Thật sai lầm khi dựa vào [nó] cho bất cứ điều gì quan trọng ngay bây giờ… chúng tôi có rất nhiều việc phải làm về tính mạnh mẽ và trung thực.”

Vậy làm thế nào để phát hành một công nghệ với mức độ hấp dẫn của ChatGPT – đó là ứng dụng tiêu dùng phát triển nhanh nhất từng được tạo ra – khi nó không đáng tin cậy, và khi nó có không có khả năng phân biệt sự thật từ hư cấu?

Các mô hình ngôn ngữ lớn có thể chứng minh hữu ích như là công cụ hỗ trợ để viết và mã hóa. Họ có thể sẽ cách mạng hóa việc tìm kiếm trên internet. Và, một ngày nào đó, khi được kết hợp một cách có trách nhiệm với người máy, chúng thậm chí có thể mang lại những lợi ích tâm lý nhất định.

Nhưng chúng cũng là một công nghệ săn mồi tiềm ẩn có thể dễ dàng lợi dụng xu hướng của con người để thể hiện tính người lên các đồ vật – một xu hướng được khuếch đại khi những đồ vật đó bắt chước một cách hiệu quả các đặc điểm của con người.![]()

Giới thiệu về Tác giả

Nir Eisikovits, Giáo sư Triết học và Giám đốc, Trung tâm Đạo đức Ứng dụng, UMass Boston

Bài viết này được tái bản từ Conversation theo giấy phép Creative Commons. Đọc ban đầu bài viết.